05/11/2025Rifiutiamo l'AI per motivi di performance o principio? Cosa dice Harvard

Questo weekend ho letto uno studio di Harvard super interessante e volevo parlartene. 👀

Il titolo è: “Performance or Principle: Resistance to Artificial Intelligence in the U.S. Labor Market”.

Magari hai già visto qualcosa in giro sui social, ma volevo approfondire meglio la questione e dirti cosa ne penso. 🙂

Allora, il focus principale dello studio era analizzare e capire meglio:

Perché non vogliamo che l’AI faccia il nostro lavoro (anche quando lo farebbe meglio)?

Vado ora più nel dettaglio…

Allora, come prima cosa, gli autori hanno chiesto a tantissime persone (parliamo di migliaia di rispondenti) di valutare 940 professioni diverse.

Di base, dovevano immaginare cosa succederebbe se un’AI potesse svolgerle in modo super preciso e a basso costo.

E il risultato è che non è tanto la tecnologia a limitarci (come alcuni potrebbero pensare)…

Ma il nostro senso morale.

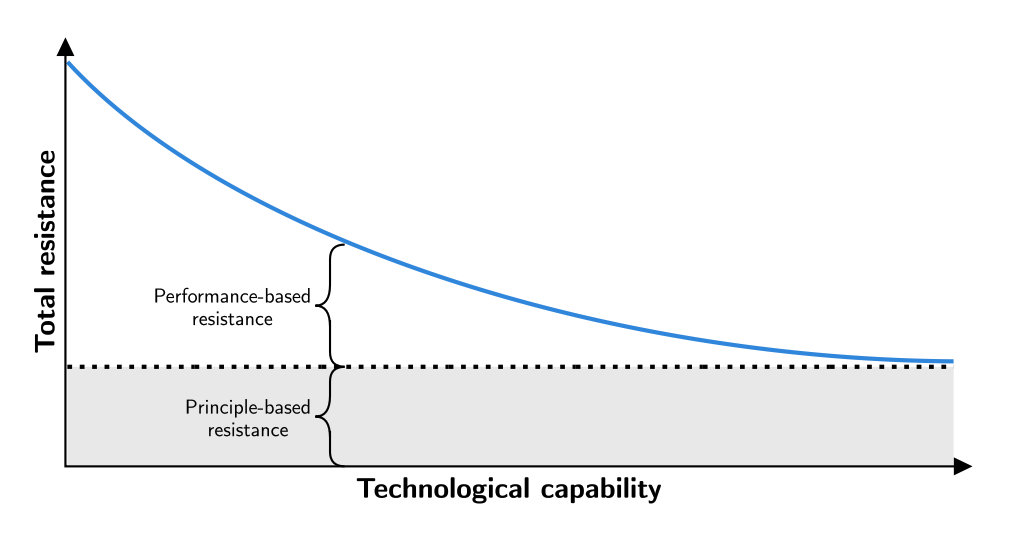

In particolare, lo studio distingue tra due forme di resistenza all’automazione:

- Da un lato c’è la resistenza basata sulla prestazione: quella che dice “no grazie, l’AI non è ancora abbastanza brava” o “costa troppo”. Ma tanto questa svanisce col miglioramento della tecnologia.

- Dall’altro lato c’è la resistenza basata sul principio: quella che afferma “questo lavoro non deve essere fatto da una macchina, mai”.

Per capirci, vediamo qualche dato.

Quando è stato chiesto alle persone cosa pensassero dell’automazione (ad oggi), è emerso che solo il 30% dei lavori è considerato accettabile da automatizzare.

Ma se si immagina l’esistenza di un’AI “perfetta” e con costi più bassi, il supporto raddoppia al 58%.

Quindi, il “no” di adesso per molti mesteri, in realtà, non è un “no” definitivo, ma un “non ancora”.

C’è poi un altro dato interessante.

Esiste un blocco di professioni (il 12%) che la gente considera intoccabili, anche se avessimo un’AI perfetta.

Sono i lavori della cura, dell’empatia, del giudizio morale e della creatività.

Per intenderci: assistenti all’infanzia, terapeuti, sacerdoti, giudici, attori…

Professioni in cui la competenza tecnica non basta, perché c’è in gioco qualcosa di umano.

Ecco, in questo caso, il supporto all’automazione rimane zero.

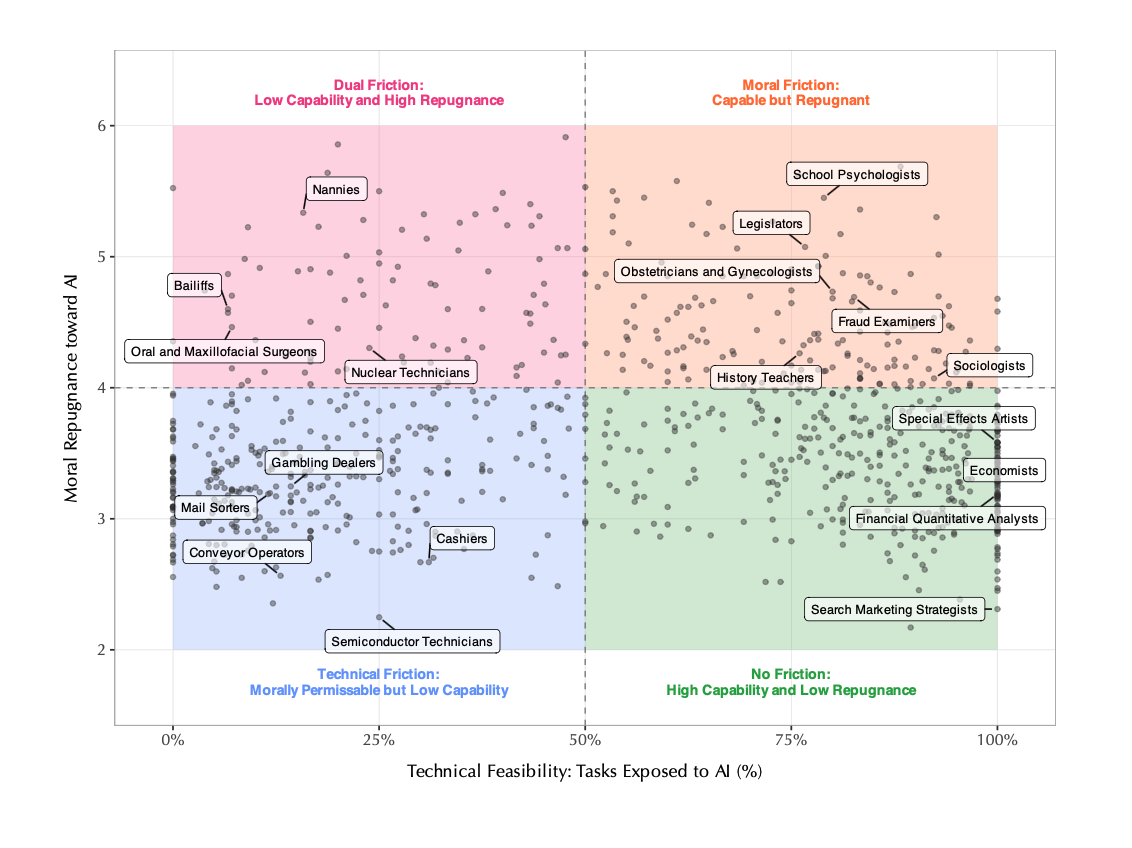

I ricercatori, quindi, mappano la situazione in quattro scenari:

1️⃣ Nessuna frizione: l’AI è pronta e socialmente accettata. Qui l’automazione corre veloce.

2️⃣ Frizione morale: l’AI è tecnicamente capace, ma la società si oppone. E qui c’è tutto il mondo dell’etica in gioco.

3️⃣ Frizione tecnica: il contrario 👉 la società è pronta, ma la tecnologia no. Appena l’AI migliora, l’adozione esploderà.

4️⃣ Doppia frizione: l’AI non è pronta e la società non la vuole. Qui le barriere sono doppie: tecniche e morali.

Di solito tratto temi o studi molto tecnici, quindi legati più all’avanzamento della tecnologia.

A sto giro, volevo fare qualcosa di diverso, analizzare meglio anche quella che è la percezione delle persone per quanto riguarda l’AI.

Che è altrettanto importante (se non più importante!).

E lo studio di Harvard fa proprio questo, non parla solo di lavoro o automazione.

Ma parla di noi e di dove, la società, traccia il confine tra ciò che può essere automatizzato e ciò che dovremmo (o vorremmo) proteggere.

La frase conclusiva dello studio riassume tutto:

Il futuro dell’AI sul lavoro sarà plasmato non solo da ciò che le macchine possono fare, ma da ciò che la società è disposta a lasciar loro fare.

E tutto questo sarà da vedere nei prossimi mesi e sicuramente sarà un dibattito sempre più acceso.

Intanto ti lascio un interessantissimo articolo del MIT che va un po’ a completare questo tema!

Giacomo Ciarlini - Head of Content & Education - Datapizza

Simone Conversano - AI Adoption Specialist - Datapizza